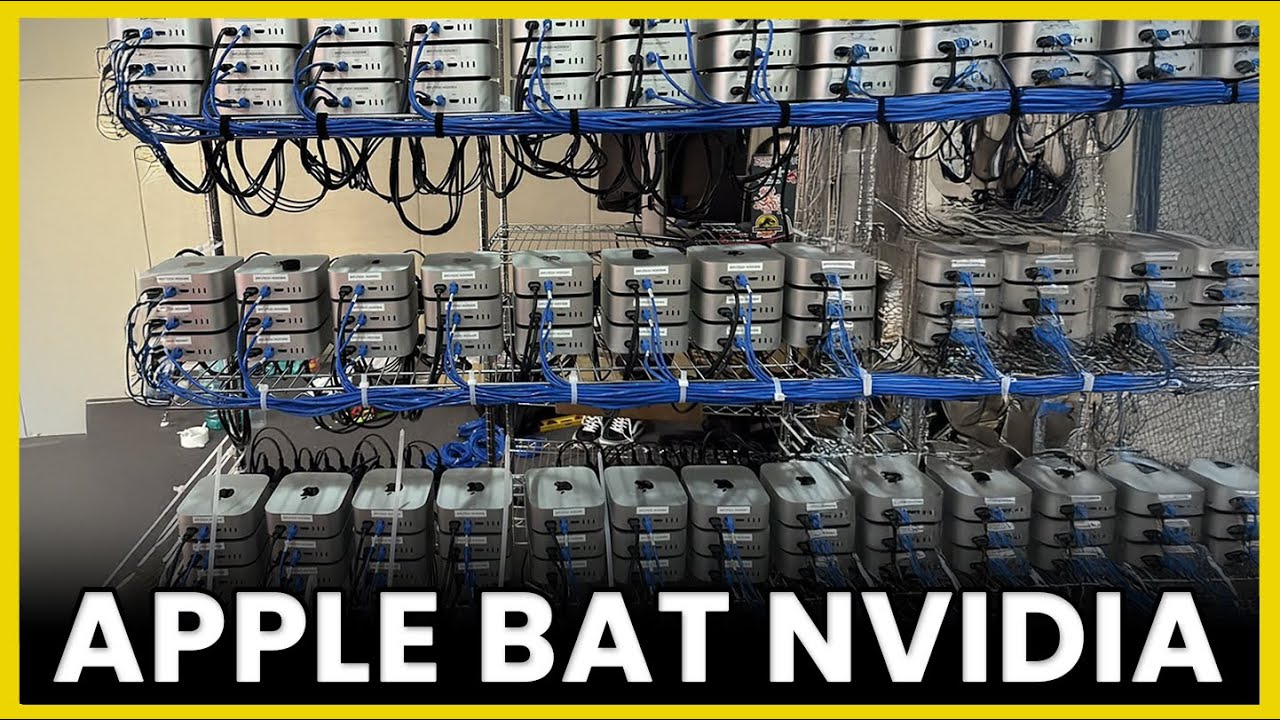

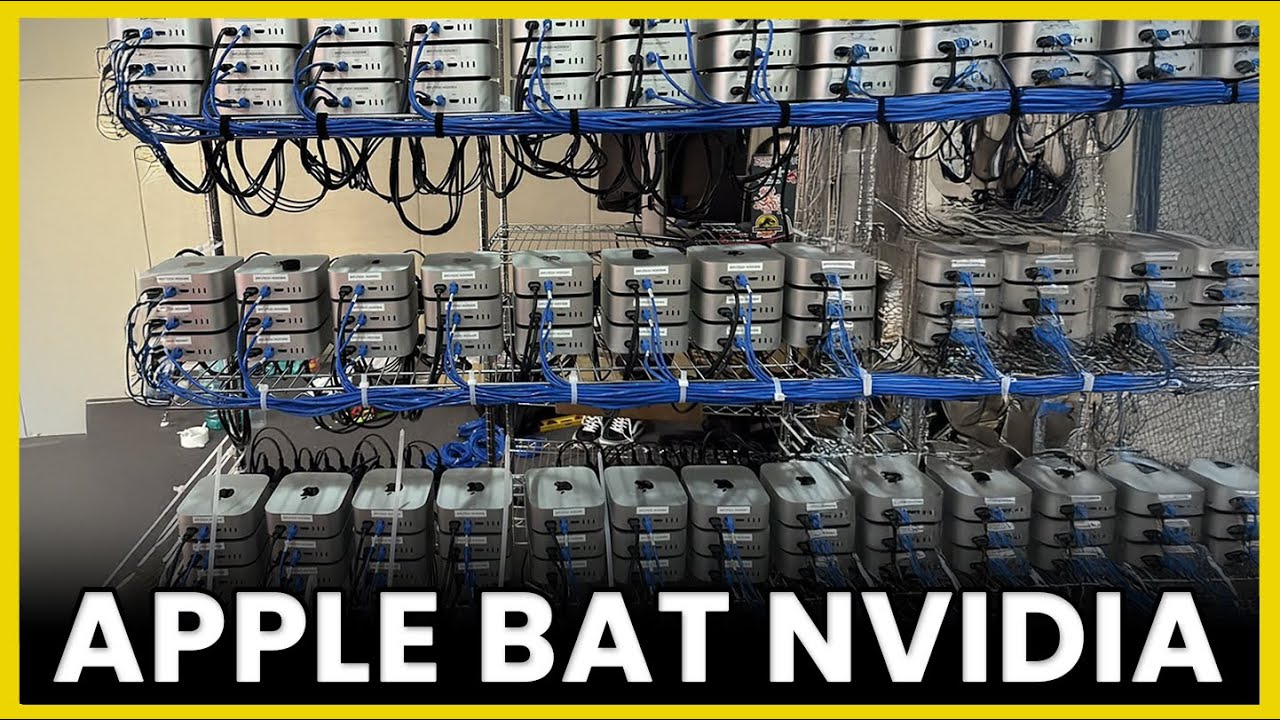

Clusters de Mac Mini : La Révolution Silencieuse d’Apple pour l’IA

Comment Apple permet de faire tourner des modèles de 1 trillion de paramètres pour une fraction du prix de Nvidia grâce au RDMA sur Thunderbolt 5

Apple vient de sortir une technologie dont personne ne parle vraiment, et pourtant elle pourrait révolutionner l’accès à l’intelligence artificielle locale. Imaginez pouvoir faire tourner des modèles de langage massifs, équivalents à ceux utilisés par les géants du cloud, directement chez vous, avec de simples Mac Mini reliés entre eux. C’est exactement ce que permet la nouvelle technologie RDMA sur Thunderbolt 5.

💰 Le Problème du Coût de la Mémoire

Dans le monde de l’IA, la mémoire est le nerf de la guerre. Pour faire tourner de gros modèles de langage (LLM), il faut énormément de mémoire VRAM. Et cette mémoire coûte une fortune.

Face à ces prix délirants, les développeurs et entreprises cherchent des alternatives. Et c’est là qu’Apple entre en jeu avec une solution inattendue : les clusters de Mac Mini.

⚔️ Mac Mini vs Nvidia H100

~500W de consommation

Silencieux

~700W de consommation

Refroidissement actif

🔗 Qu’est-ce qu’un Cluster de Mac Mini ?

Un cluster, c’est un ensemble de machines interconnectées qui peuvent partager leurs ressources comme si elles ne formaient qu’un seul super-ordinateur. Traditionnellement, les clusters utilisent des connexions Ethernet classiques ou Gigabit. Mais Apple a fait les choses différemment.

Pas d’Ethernet

Contrairement aux clusters traditionnels, aucune connexion Ethernet n’est nécessaire

Thunderbolt 5

Connexion physique via câbles TB5 avec 80-120 Go/s bidirectionnel

Maillage Direct

Les Mac sont chaînés entre eux sans switch réseau spécial

Mémoire Partagée

Accès direct à la mémoire unifiée de chaque Mac

⚙️ La Magie du RDMA sur Thunderbolt 5

Le RDMA (Remote Direct Memory Access) est la grande nouveauté d’Apple en 2025. Cette technologie permet à un Mac d’accéder directement à la mémoire unifiée d’un autre Mac, sans passer par le CPU.

Performances Exceptionnelles

La latence est de l’ordre de 5 microsecondes, ce qui réduit énormément les goulots d’étranglement de communication. Résultat : le cluster est 10 fois plus rapide que les anciennes méthodes via Ethernet 10 Gbit ou Thunderbolt classique.

Pourquoi ce n’est pas possible sur PC ?

Les plateformes AMD, même haut de gamme, utilisent l’USB 4 qui plafonne à 40 Go/s. De plus, l’USB 4 ne dispose pas de la fonction RDMA, ce qui rendrait un cluster AMD beaucoup plus lent, obligeant à passer par Ethernet classique.

💻 Exo : Le Logiciel qui Rend Tout Possible

Exo est le logiciel principal utilisé pour orchestrer ces clusters. Il permet le parallélisme par tenseur : le modèle d’IA est découpé en petits morceaux appelés « shards » qui sont répartis sur les différents GPU des Mac.

Découpage du modèle

Le LLM est divisé en shards (fragments) selon les besoins mémoire

Distribution

Chaque shard est assigné à un Mac Mini du cluster

Communication RDMA

Les Mac communiquent directement via Thunderbolt 5 avec une latence ultra-basse

Inférence

Le modèle génère des tokens en parallèle sur tous les GPU

📊 Configurations et Performances

| Configuration | Mémoire Totale | Capacité Modèle | Prix Estimé |

|---|---|---|---|

| 4-5 Mac Mini M4 Pro | 256-320 Go | 200-235 Mds paramètres | ~10 000€ |

| 4 Mac Mini Studio 512 Go | 1,5 To+ | Jusqu’à 1 trillion | ~68 000€ |

| 4 Nvidia H100 | 320 Go HBM3 | Similaire aux Studios | ~120 000€ |

4 Mac Mini Studio peuvent faire tourner des modèles MoE (Mixture of Experts) comme Qwen2 Thinking avec jusqu’à 1,5 To de mémoire unifiée accessible !

🔋 L’Avantage Énergétique Massif

Au-delà du coût d’achat, la consommation électrique est un facteur crucial pour les déploiements IA.

C’est un ratio de 10:1 en faveur d’Apple ! Sur une année d’utilisation intensive, les économies d’électricité peuvent se chiffrer en milliers d’euros.

⚖️ Le Pour et le Contre

✅ Avantages

- Coût d’entrée beaucoup plus bas que Nvidia

- Consommation électrique 10x inférieure

- Silence de fonctionnement

- Privacy totale (pas de cloud)

- Technologie « future-proof » avec Thunderbolt 5

- Parfait pour l’inférence de gros modèles

❌ Inconvénients

- Limité à l’écosystème Apple

- Nécessite des Mac récents (M3 Ultra, M4)

- Topologie en chaîne : goulots possibles au-delà de 4-5 machines

- Moins optimisé que CUDA pour certains workloads

- Réservé à l’inférence, pas à l’entraînement massif

🖥️ Mac Compatibles

Tous les Mac ne supportent pas le RDMA sur Thunderbolt 5. Voici les modèles compatibles :

Mac Mini M3 Ultra

Jusqu’à 192 Go de mémoire unifiée

Mac Mini M4 Pro

Jusqu’à 64 Go, rapport qualité-prix optimal

Mac Studio M4

Jusqu’à 512 Go pour les charges massives

Les Mac plus anciens (M1, M2 classiques) ne disposent pas de la fonction RDMA sur Thunderbolt et ne sont donc pas compatibles avec cette technologie de cluster.

🎯 Pour Qui ? Pour Quoi ?

✅ Idéal pour :

Les développeurs, chercheurs ou entreprises qui souhaitent faire de l’inférence sur des modèles massifs tout en gardant leurs données en local. Parfait pour des systèmes RAG d’entreprise, des assistants IA privés, ou des applications nécessitant des modèles de pointe sans dépendre du cloud.

❌ Pas adapté pour :

L’entraînement massif de modèles (là, Nvidia reste roi avec CUDA). Les clusters Mac sont optimisés pour l’inférence, c’est-à-dire faire « tourner » des modèles déjà entraînés, pas pour les créer from scratch.

🏁 Conclusion

Apple, souvent critiqué pour son retard en matière d’IA, vient de démontrer qu’il peut révolutionner l’accès aux gros modèles de langage. Avec le RDMA sur Thunderbolt 5, la firme de Cupertino permet de construire des clusters d’inférence IA pour une fraction du prix de Nvidia, avec une consommation électrique dix fois inférieure.

Pour ceux qui sont déjà dans l’écosystème Apple et qui priorisent le coût, la privacy et le silence, c’est actuellement l’une des meilleures solutions en rapport qualité-prix pour faire tourner de gros LLM en local. Une vraie démocratisation de l’IA de pointe, sans passer par le cloud.

📺 Voir la Vidéo Complète

Cliquez pour regarder la vidéo sur YouTube